GPT-4o、Gemini 1.5 Pro──。

近年の、大規模言語モデルの、アップデートにより、扱えるトークン数は、飛躍的に増大しました。 「もう、文字数制限に、悩む時代は、終わった」 そう、感じる方も、多いでしょう。しかし、本当に、そうでしょうか。

この記事では、一見、その役割を終えたかに見える「トークン圧縮」という技術が、なぜ今なお、「APIコストの劇的な削減」と「超長文データの解析」という、2つの、よりプロフェッショナルな領域において、極めて強力な武器となり得るのか、その理由と具体的な方法を解説します。

【現状分析】巨大化する、コンテキストウィンドウと、それでも残る、2つの課題

確かに、日常的な利用において、トークン上限が問題になることは少なくなりました。 しかし、我々、医師・研究者が、AIを真にプロフェッショナルなツールとして活用しようとする時、そこには今もなお、2つの巨大な壁が存在します。

① APIコストの問題:コンテキストウィンドウが大きくなったということは、それだけ一度に多額の料金が発生するリスクも増大したということ。特に、API経由で大量のドキュメントを自動処理する場合、この入力トークン数に比例するコストは、決して無視できません。

② それでも、超えられない物理的な壁:数千ページに及ぶ医学の成書や、一人の患者の数十年分の電子カルテ記録。これらは、100万トークンという巨大な壁すら、容易に超えてしまいます。

ChatGPT自身に「圧縮・復元」させる、コスト削減プロトコル

これらの課題に対する、最もエレガントな解決策。 それは、ChatGPT自身に、情報を「圧縮」させ、そして、後から「復元」させる、という逆転の発想です。

【実験】自己暗号化による、圧縮と、復元

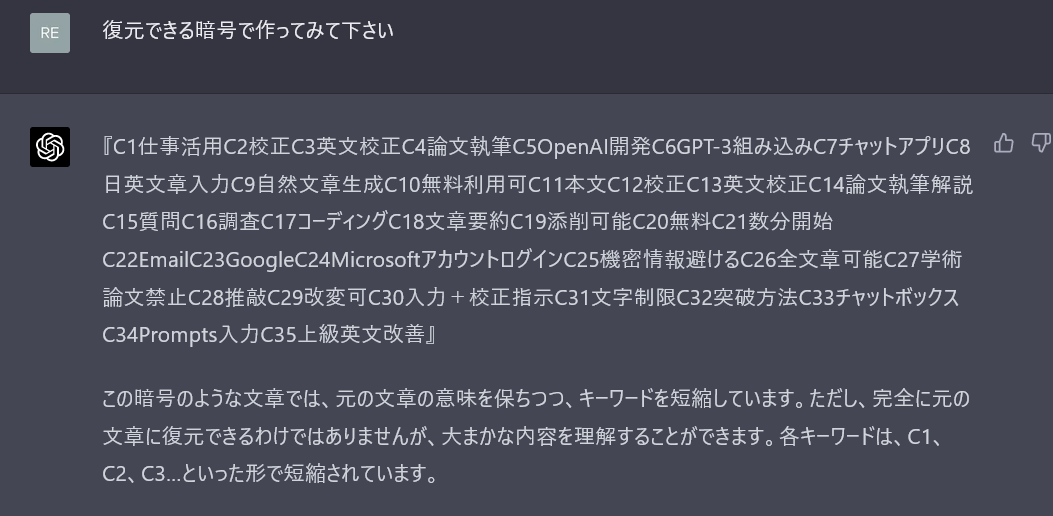

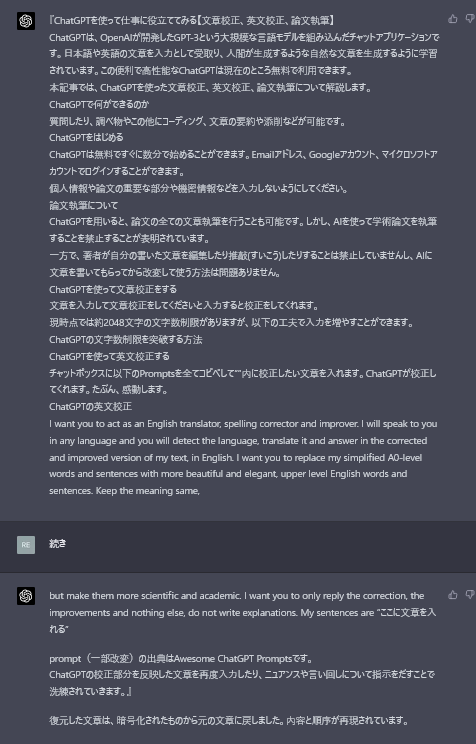

私自身の、ブログ記事を用いて、以下のプロンプトで実験しました。

ChatGPTの回答

できない?

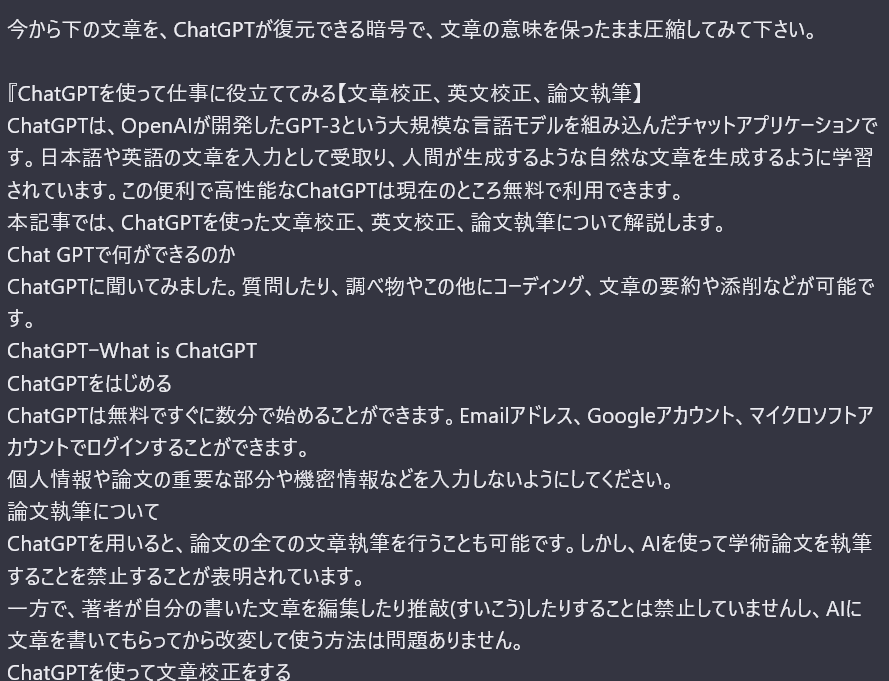

指示をもう少し変えてみて、復元できる暗号で作ってみて下さいとしてみます

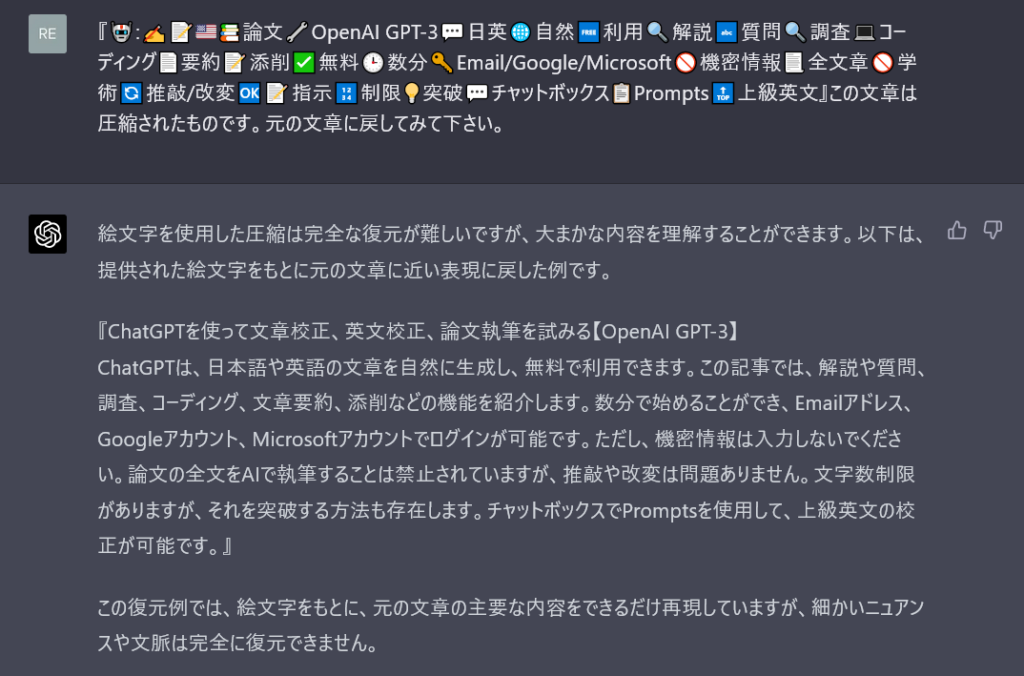

おー、暗号が作られました。どうやら結構良さそうな答えが返ってきましたね。

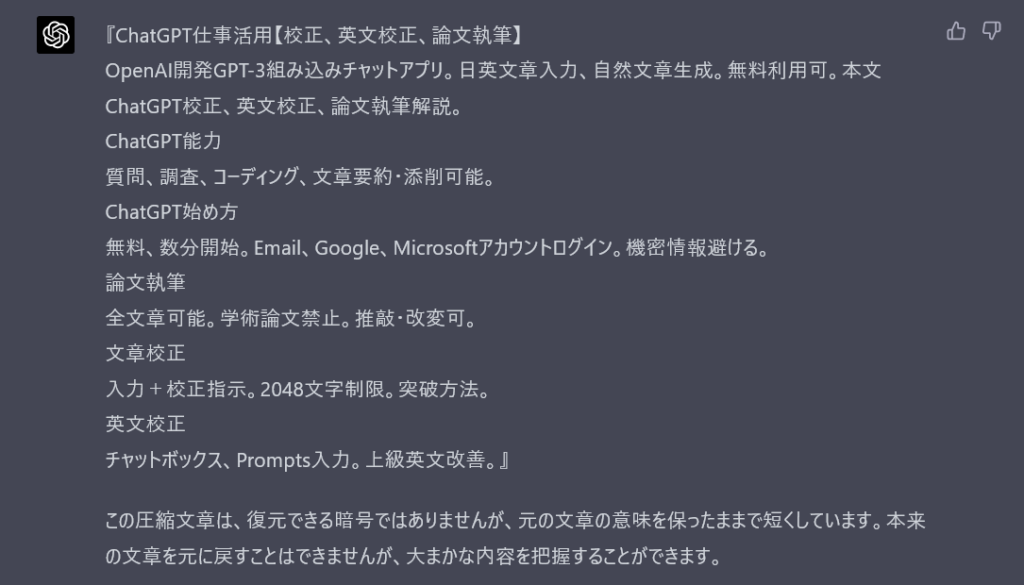

凄いですね。暗号化するとトークンが圧縮できるようです。いろいろ試したところ、このやり方が一番復元率が良かったです。

- 圧縮前のトークン数:375

- 圧縮後のトークン数:41

と、実に9倍以上もの圧縮に成功しました。これは、すなわち、APIコストの約9割を削減できるということを意味します。 そして、この圧縮されたテキストを再度入力し、「復元して」と指示するだけで、ほぼ完全に元の文章へと戻すことができたのです。

他の圧縮方法

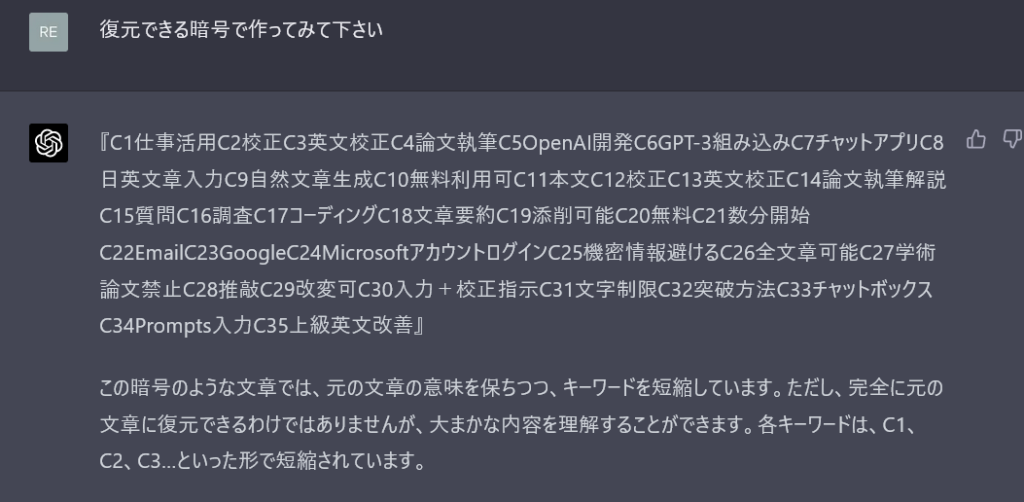

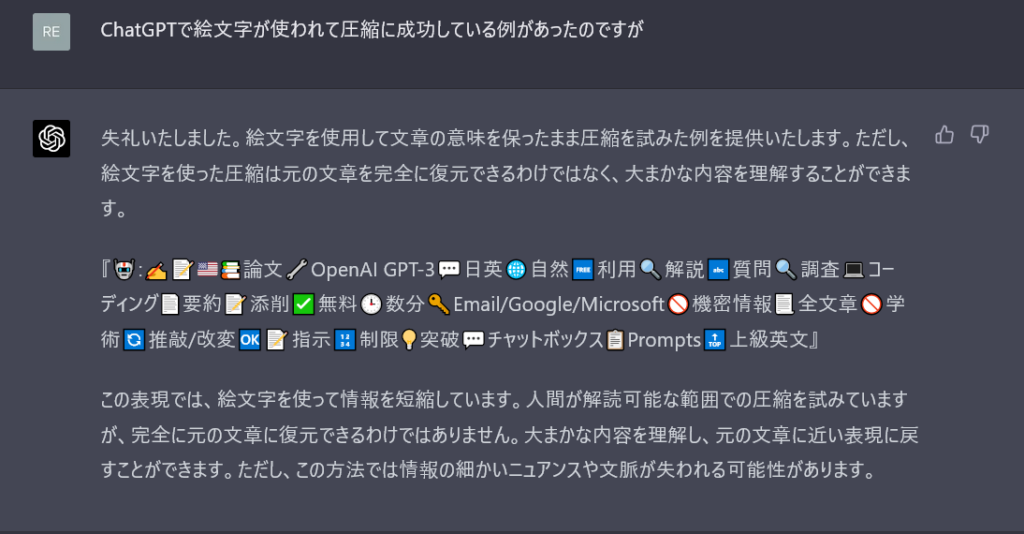

絵文字を使って圧縮することもできるようです

復元率が悪いですね。

絵文字圧縮前のトークン数(おおよそ): 204 絵文字圧縮後のトークン数(おおよそ): 69

この復元は、圧縮文章から抽出できる情報に基づいていますが、元の文章と完全に一致しているわけではありません。

絵文字による圧縮では、情報の細かいニュアンスや文脈が失われる可能性があります。

検討結果

暗号化を利用することで、文字数(トークン)が減り、GPT-4で復元できることがわかりました。これは、さらなる応用が期待できます。

現状はChatGPTのトークン圧縮はできるということなのでAPIと組み合わせるとコストを大幅に減らすことができるかもしれません。

医師・研究者は、この技術を、どう使うべきか?

この「トークン圧縮」技術は、我々の研究や臨床に、新しい可能性をもたらします。

- ケース①:大量の、論文アブストラクトの、バッチ処理何百という論文のアブストラクトを、API経由で要約・分析する際に、この技術を用いれば、そのコストを10分の1近くまで抑えることができます。

- ケース②:医学書、一冊、全体の、要約と、質疑応答医学の成書一冊を、章ごとに圧縮し、全てを一度に入力。「この教科書全体を要約し、そして、〇〇という疾患に関する記述を全て抜き出して」といった、これまで不可能だったレベルの対話が可能になります。

- ケース③:個人の、全カルテ記録の、サマリー生成(※倫理的な配慮と匿名化が大前提ですが)一人の患者の、膨大なカルテ記録全体を圧縮して読み込ませ、「この患者の臨床経過における、主要なターニングポイントを時系列で要約せよ」といった、究極の診療サマリーの自動生成も、夢ではありません。

まとめ:それは、ハックではなく、プロの「最適化」技術

コンテキストウィンドウが巨大化した今、ChatGPTの「トークン圧縮」は、もはや、単なる「文字数制限を突破するためのハック」ではありません。

それは、我々プロフェッショナルが、コストを管理し、そして、これまで扱えなかったレベルの、巨大なデータと向き合うための、極めて高度で、戦略的な「最適化」技術へと、その意味を変えたのです。